Spark DataframeをPython辞書型変数に変換する際の注意点

Spark Dataframeは高速に大容量データを処理するための強力なツールですが、そのままPythonの辞書型変数に変換することはできません。Dataframeを辞書型変数に変換するには、collectメソッドやtoPandasメソッドを使用するのが一般的です。しかし、このような変換を行う際には、性能やメモリーの問題に注意しなければなりません。此外、Dataframeのサイズや構造によっては、変換することができない場合もあります。本稿では、について詳しく説明します。

Spark DataframeをPython辞書型変数に変換する際の注意点

Spark DataframeをPython辞書型変数に変換する際には、注意するべきポイントがいくつかあります。以下では、具体的にどのような注意点があるのかを説明します。

1. Dataframeのコレクションのサイズ

DataframeをPython辞書型変数に変換する際には、Dataframeのコレクションのサイズに注意する必要があります。大量のデータを持つDataframeを変換すると、メモリーの問題が発生する可能性があります。そのため、Dataframeのサイズを事前に確認し、必要なデータのみを選択することが重要です。

2. カラムのデータ型

DataframeをPython辞書型変数に変換する際には、カラムのデータ型に注意する必要があります。文字列型や日付型などのカラムは、適切に処理する必要があります。また、Python辞書型変数では、データ型の変換が必要になるケースもあります。

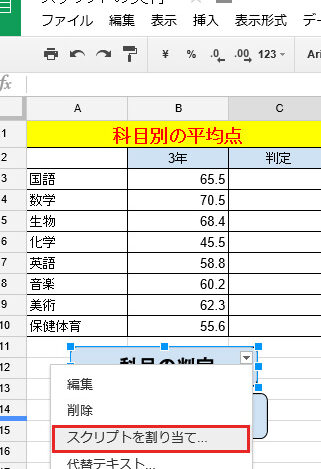

Spreadsheet GAS入門:マクロを図形に割り当てる方法3. NA値の処理

DataframeをPython辞書型変数に変換する際には、NA値の処理に注意する必要があります。NA値を保持したまま変換すると、Python辞書型変数での処理に問題が発生する可能性があります。そのため、NA値を適切に処理する必要があります。

4. スキーマの保持

DataframeをPython辞書型変数に変換する際には、スキーマの保持に注意する必要があります。スキーマ情報を保持したまま変換すると、Python辞書型変数での処理に問題が発生する可能性があります。そのため、スキーマ情報を適切に保持する必要があります。

5. パフォーマンスの考慮

DataframeをPython辞書型変数に変換する際には、パフォーマンスの考慮に注意する必要があります。大量のデータを持つDataframeを変換する場合、パフォーマンスの問題が発生する可能性があります。そのため、適切なパフォーマンスを考慮した変換方法を選択する必要があります。

| 注意点 | 対処方法 |

|---|---|

| 大量のデータ | Dataframeのサイズを事前に確認 |

| カラムのデータ型 | 適切にデータ型を変換 |

| NA値 | NA値を適切に処理 |

| スキーマの保持 | スキーマ情報を適切に保持 |

| パフォーマンス | 適切なパフォーマンスを考慮 |

よくある質問

Spark DataFrameをPython辞書型変数に変換する際には、どのようなパフォーマンスの影響があるか?

Spark DataFrameをPython辞書型変数に変換することで、パフォーマンスが大きく低下する可能性があります。特に、大規模なDataFrameの場合、変換処理に要する時間が長くなり、システムのリソースを消費します。また、Python辞書型変数に変換されたデータは、メモリーに対して大きな影響を与えることになりますTherefore, it is necessary to carefully consider the conversion of Spark DataFrame to a Python dictionary variable, especially when dealing with large-scale data.

Spring Boot 2.x:Spring Cloud Netflix Hystrix編Spark DataFrameをPython辞書型変数に変換する際には、どのようなデータ型の変換が生じるか?

Spark DataFrameをPython辞書型変数に変換する際には、各列のデータ型がPythonの基本データ型に変換されます。例えば、Spark DataFrameの整数型列はPythonのint型に、文字列型列はstr型に変換されます。また、null値やNaN値もPythonのNone型に変換されます。ただし、Spark DataFrameの構造体や配列型列は、Pythonの辞書型やリスト型に変換されるため、注意が必要です。

Spark DataFrameをPython辞書型変数に変換する際には、どのようなエラーハンドリングが必要か?

Spark DataFrameをPython辞書型変数に変換する際には、エラーハンドリングが適切に行われていないと、変換エラーが生じる可能性があります。例えば、データ型の変換エラーや、null値の処理エラーなどが生じる可能性があります。また、メモリーーークションやリソースーのークションも考慮する必要があります。したがって、適切なエラーハンドリングを行うことで、変換エラーの発生を防ぐことができます。

Spark DataFrameをPython辞書型変数に変換する際には、どのような最適化方法があるか?

Spark DataFrameをPython辞書型変数に変換する際には、最適化方法として、変換対象のデータサイズを小さくすることが挙げられます。また、パフォーマンス向上のために、parallelizeやbroadcastのような並列処理を活用することもできます。これにより、変換時間を短縮し、システムのリソースを有効利用することができます。